AI技術の進化に伴い、AIガバナンスの重要性が高まっています。本記事では、AIガバナンスの基礎からリスク管理、社会実装までを解説します。AIの可能性を最大限に引き出し、リスクを最小限に抑えるための知識を身につけましょう。

目次

ToggleAIガバナンスとは?

AIガバナンスの定義

AIガバナンスとは、AIシステムの開発、運用、利用に関する組織的な枠組みを指します。その目的は、倫理的な懸念や法的リスクを適切に管理し、AIの責任ある利用を促進することにあります。AIガバナンスは、AI技術が社会に浸透するにつれて、ますます重要性を増しています。AIシステムが人々の生活に大きな影響を与える可能性があるため、その開発と利用は慎重に進められる必要があります。AIガバナンスは、AI技術の潜在的なリスクを最小限に抑えつつ、その恩恵を最大限に引き出すための羅針盤となるでしょう。組織はAIガバナンスを通じて、透明性、説明責任、公平性を確保し、社会からの信頼を得ることができます。AIガバナンスの確立は、AI技術の持続可能な発展に不可欠であると言えるでしょう。

なぜAIガバナンスが必要なのか

AI技術の急速な発展は、プライバシー侵害、バイアス、誤情報拡散など、様々なリスクをもたらします。AIガバナンスは、これらのリスクを特定し、軽減するための重要な手段です。特に、AIシステムが社会の意思決定に影響を与える場合、その透明性と公平性は厳格に確保されなければなりません。AIガバナンスは、AI技術がもたらす潜在的な負の影響を最小限に抑え、社会全体にとって有益な方向に導くための枠組みです。企業や組織は、AIガバナンスを確立することで、法的責任を果たすだけでなく、倫理的な観点からも信頼性を高めることができます。AIガバナンスの重要性は、今後ますます高まることが予想されます。

AIガバナンスの構成要素

AIガバナンスは、倫理原則、法的規制、技術的対策、組織文化など、多岐にわたる要素で構成されます。これらの要素を統合的に管理することで、効果的なAIガバナンスを実現できます。倫理原則は、AIシステムの開発と利用における指針となり、人権の尊重、公平性、透明性などを重視します。法的規制は、AI技術の利用に関する法的責任や義務を明確にし、プライバシー保護やデータセキュリティなどを定めます。技術的対策は、AIシステムの安全性や信頼性を確保するための技術的な手法であり、バイアス軽減や説明可能性の向上などを目指します。組織文化は、組織全体でAI倫理を重視し、責任あるAI利用を促進する文化を醸成します。これらの要素が相互に連携し、AIガバナンスの全体像を形作ります。

AIリスクの特定と評価

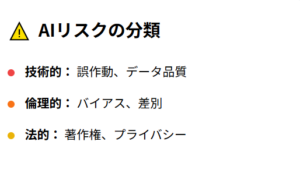

AIリスクの種類

AIリスクには、技術的なリスク、倫理的なリスク、法的リスク、運用上のリスクなどがあります。これらのリスクを網羅的に特定し、評価する必要があります。技術的なリスクとしては、AIシステムの誤作動や脆弱性、データの品質問題などが挙げられます。倫理的なリスクとしては、バイアスによる差別、プライバシー侵害、説明責任の欠如などが挙げられます。法的リスクとしては、個人情報保護法違反、著作権侵害、製造物責任などが挙げられます。運用上のリスクとしては、AIシステムの運用コストの増大、人材不足、技術の変化への対応の遅れなどが挙げられます。これらのリスクを総合的に考慮し、適切な対策を講じる必要があります。AIリスクの特定と評価は、AIガバナンスの基礎となる重要なプロセスです。

リスク評価の方法

リスク評価には、定性的な評価と定量的な評価があります。定性的な評価では、専門家の意見や過去の事例を参考にリスクを評価します。一方、定量的な評価では、統計的な手法を用いてリスクを数値化します。定性的な評価は、リスクの性質や影響範囲を理解するのに役立ちます。定量的な評価は、リスクの優先順位付けや対策の効果測定に役立ちます。リスク評価の結果は、リスク管理計画の策定やAIシステムの設計・開発に反映されます。リスク評価は、一度行えば終わりではなく、定期的に見直し、必要に応じて更新する必要があります。AI技術の進歩や社会の変化に伴い、新たなリスクが発生する可能性があるためです。リスク評価を継続的に行うことで、AIリスクを効果的に管理することができます。

リスク管理のプロセス

リスク管理は、リスクの特定、評価、対策の実施、モニタリングという一連のプロセスで構成されます。このプロセスを継続的に実施することで、AIリスクを効果的に管理できます。リスクの特定では、考えられる全てのリスクを洗い出し、その性質や原因を分析します。リスクの評価では、リスクの発生確率や影響度を評価し、優先順位を決定します。対策の実施では、リスクを軽減するための具体的な対策を策定し、実行します。モニタリングでは、対策の効果を定期的に評価し、必要に応じて改善を行います。リスク管理は、組織全体で取り組むべき課題であり、経営層のコミットメントが不可欠です。また、リスク管理のプロセスは、透明性を確保し、関係者とのコミュニケーションを密にすることが重要です。リスク管理を適切に行うことで、AI技術の安全かつ効果的な利用を促進することができます。

AIガバナンスの社会実装

ステークホルダーとの連携

AIガバナンスの社会実装には、政府、企業、研究機関、市民社会など、様々なステークホルダーとの連携が不可欠です。ステークホルダー間の対話を通じて、共通の理解を深めることが重要です。政府は、AIに関する政策や規制を策定し、AI技術の健全な発展を促進します。企業は、AI技術の開発・利用において、倫理的な責任を果たし、社会的な課題解決に貢献します。研究機関は、AI技術の安全性や倫理に関する研究を行い、社会に貢献します。市民社会は、AI技術の利用に関する意見を表明し、AIガバナンスの透明性を確保します。これらのステークホルダーが連携することで、AI技術が社会に受け入れられ、その恩恵を最大限に享受できるようになります。ステークホルダーとの連携は、AIガバナンスの社会実装において、最も重要な要素の一つです。

国際的な動向

AIガバナンスに関する国際的な議論が活発化しています。EUのAI法案やOECDのAI原則など、国際的な規範や規制の動向を把握し、自社のAIガバナンス戦略に反映させる必要があります。EUのAI法案は、AI技術のリスクレベルに応じて規制を設けることを目指しています。OECDのAI原則は、AI技術の開発・利用における倫理的な指針を示しています。これらの国際的な動向を踏まえ、企業は、グローバルな視点からAIガバナンス戦略を策定する必要があります。また、国際的な標準化団体も、AIガバナンスに関する規格の開発を進めています。これらの規格を活用することで、AIガバナンスの国際的な整合性を確保することができます。国際的な動向を常に把握し、自社のAIガバナンス戦略に反映させることが重要です。

人材育成と組織文化

AIガバナンスを効果的に機能させるためには、AI倫理やリスク管理に関する専門知識を持つ人材の育成が重要です。また、組織全体でAIガバナンスの重要性を共有し、責任あるAI利用を促進する文化を醸成する必要があります。AI倫理に関する研修プログラムを導入したり、AIリスク評価の専門家を育成したりすることが有効です。また、組織全体でAI倫理に関する議論を活発化させ、従業員の意識を高めることも重要です。経営層がAIガバナンスの重要性を理解し、率先して取り組む姿勢を示すことが、組織文化の醸成につながります。AIガバナンスに関する人材育成と組織文化の醸成は、AI技術の健全な発展に不可欠な要素です。

AIガバナンスの実践事例

企業の取り組み事例

多くの企業が、AI倫理委員会を設置したり、AIリスク評価プロセスを導入したりするなど、AIガバナンスの取り組みを始めています。これらの事例を参考に、自社に適したAIガバナンス体制を構築できます。例えば、ある企業では、AI倫理委員会がAIシステムの開発段階から倫理的な観点をチェックし、バイアスやプライバシー侵害のリスクを軽減しています。また、別の企業では、AIリスク評価プロセスを導入し、AIシステムの潜在的なリスクを特定し、対策を講じています。これらの企業の取り組み事例は、AIガバナンスの実践における参考となるでしょう。自社の事業内容や規模に合わせて、適切なAIガバナンス体制を構築することが重要です。

行政の取り組み事例

行政機関も、AIの利用に関するガイドラインを策定したり、AI技術の倫理的な影響に関する研究を支援したりするなど、AIガバナンスの推進に貢献しています。例えば、ある行政機関では、AIの利用に関するガイドラインを策定し、AIシステムの開発・利用における倫理的な原則を示しています。また、別の行政機関では、AI技術の倫理的な影響に関する研究を支援し、AIガバナンスの推進に貢献しています。これらの行政の取り組み事例は、AIガバナンスの社会実装における参考となるでしょう。行政と企業が連携し、AIガバナンスを推進することが重要です。

今後の展望と課題

AIガバナンスの進化

AI技術の進化に伴い、AIガバナンスも進化し続ける必要があります。新たなリスクや課題に対応するために、継続的な学習と改善が不可欠です。AI技術は、常に変化しており、それに伴い、新たなリスクや課題が発生する可能性があります。AIガバナンスは、これらの変化に柔軟に対応し、常に最新の状態に保つ必要があります。継続的な学習と改善を通じて、AIガバナンスの効果を高めることが重要です。また、AIガバナンスに関する国際的な議論も活発化しており、その動向を常に把握する必要があります。

課題と対策

AIガバナンスの課題としては、技術的な複雑さ、倫理的な価値観の多様性、グローバルな連携の難しさなどが挙げられます。これらの課題を克服するために、産学官連携を強化し、国際的な協調を促進する必要があります。技術的な複雑さに対しては、AI技術に関する知識を持つ人材を育成することが重要です。倫理的な価値観の多様性に対しては、ステークホルダー間の対話を通じて、共通の理解を深めることが重要です。グローバルな連携の難しさに対しては、国際的な標準化団体との連携を強化することが重要です。これらの課題を克服することで、AIガバナンスの効果を高めることができます。

まとめ

AIガバナンスは、AI技術の健全な発展と社会への実装に不可欠な要素です。本記事で解説した知識を参考に、AIガバナンスの重要性を理解し、自社のAI戦略に組み込んでください。AIガバナンスを適切に実施することで、AI技術の潜在的なリスクを最小限に抑えつつ、その恩恵を最大限に引き出すことができます。また、AIガバナンスは、企業や組織の信頼性を高め、社会からの支持を得るためにも重要です。AIガバナンスに関する知識を深め、自社のAI戦略に組み込むことで、持続可能なAI技術の発展に貢献することができます。AIガバナンスは、今後ますます重要性を増すことが予想されます。