AIアライメントは、AIが人間の価値観や目標に沿って行動するようにするための重要な研究分野です。本記事では、AIアライメントの基本概念から、その重要性、直面する課題、そして具体的な実現方法までをわかりやすく解説します。

目次

ToggleAIアライメントとは何か?

AIアライメントの定義と必要性

AIアライメントとは、AIシステムが人間の意図や価値観と整合するように設計・開発・運用することを目指す分野です。AI技術が高度化するにつれて、AIが予期せぬ行動をとったり、人間の価値観に反する結果をもたらしたりするリスクが高まっています。そのため、AIアライメントの重要性はますます高まっています。

具体的には、AIが倫理的原則や社会的規範から逸脱しないように、その挙動を制御し、人間の意図に沿った目標を達成するように導くことが求められます。AIアライメントは、単なる技術的な問題ではなく、倫理的、社会的な側面も含む複雑な課題であり、学際的なアプローチが不可欠です。AI技術の進歩とともに、AIアライメントの重要性はますます高まり、その研究と実践は、より安全で信頼できるAIシステムの構築に不可欠な要素となります。AIアライメントへの取り組みは、AI技術が社会に貢献し、人類の福祉に寄与するための基盤を築く上で重要な役割を果たします。

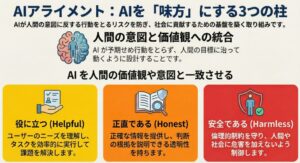

AIアライメントの目標:役に立ち、正直で、安全なAI

AIアライメントの主な目標は、AIが「役に立ち(Helpful)」、「正直であり(Honest)」、「安全である(Harmless)」ようにすることです。これは、AIが人間のニーズを満たし、誤った情報を拡散せず、危害を加えないようにするための基本的な原則となります。Anthropicなどの企業がこの目標を掲げています。

「役に立つ」とは、AIが人間の問題を解決し、タスクを効率的に実行できる能力を指します。AIは、ユーザーのニーズを理解し、適切な情報を提供し、必要な支援を行うことが求められます。「正直である」とは、AIが正確な情報を提供し、誤解を招くような行動を避けることを意味します。AIは、透明性を持ち、自らの判断根拠を説明できる必要があります。「安全である」とは、AIが人間や社会に危害を加えないように設計されることを指します。AIは、倫理的な制約を守り、意図しない結果を引き起こさないように制御される必要があります。これらの目標を達成するために、AIアライメントの研究は、技術的な課題だけでなく、倫理的な問題や社会的な影響も考慮に入れています。

AIアライメントが重要な理由

AIの潜在的なリスクと倫理的問題

AIが人間の価値観と整合しない場合、偏見の助長、差別の強化、プライバシー侵害、誤情報の拡散など、様々な倫理的問題を引き起こす可能性があります。また、AIが自律的に行動するようになると、制御不能になるリスクも懸念されます。

特に、AIが学習データに偏りがある場合、その偏見を増幅させ、社会的な不公平を助長する可能性があります。例えば、採用選考AIが特定の性別や人種に対して不利な判断を下すようなケースが考えられます。また、AIが個人情報を不適切に収集・利用することで、プライバシー侵害のリスクが高まります。さらに、AIが生成する誤情報やフェイクニュースが拡散されることで、社会の信頼を損なう可能性があります。AIアライメントは、これらのリスクを軽減し、AIが倫理的に責任ある行動をとるようにするための重要な取り組みです。AI技術の開発者は、倫理的なガイドラインを遵守し、AIの挙動を監視・制御するための技術を開発する必要があります。

ビジネスにおけるAIアライメントの重要性

企業がAIを導入する際、AIアライメントは、信頼性の向上、レピュテーションリスクの低減、法的コンプライアンスの確保に不可欠です。倫理的なAI利用は、顧客や社会からの信頼を得る上で重要な要素となります。

企業がAIアライメントを重視することで、顧客からの信頼を得やすくなります。顧客は、倫理的に利用されているAIサービスを安心して利用できるため、企業に対するロイヤリティが高まります。また、AIアライメントは、企業がレピュテーションリスクを低減する上で役立ちます。AIが倫理的な問題を引き起こした場合、企業の評判は大きく損なわれる可能性がありますが、AIアライメントに取り組むことで、そのようなリスクを回避できます。さらに、AIアライメントは、企業が法的コンプライアンスを確保する上で不可欠です。AIの利用に関する法規制はますます厳しくなっており、AIアライメントに取り組むことで、法的なリスクを低減できます。企業は、AIアライメントをビジネス戦略の一環として捉え、積極的に取り組む必要があります。

AIアライメントの課題

価値観の多様性と定義の難しさ

人間の価値観は多様であり、文化、社会、個人の経験によって異なります。そのため、「正しい」価値観をAIに組み込むことは非常に困難です。また、抽象的な価値観をAIが理解できる形に定義することも大きな課題となります。

例えば、「公平性」という価値観をAIに組み込む場合、どのような基準で公平性を判断するのかを明確にする必要があります。しかし、公平性の定義は、状況や文化によって異なるため、普遍的な基準を定めることは困難です。また、「プライバシー」という価値観をAIに組み込む場合、どのような情報を保護し、どのように利用するかを明確にする必要があります。しかし、プライバシーの定義も、個人の価値観や社会的な規範によって異なるため、一律的な基準を定めることは困難です。AIアライメントの研究者は、これらの課題を解決するために、多様な価値観を考慮し、AIが倫理的な判断を下せるようにするための技術を開発する必要があります。

スケーラビリティの問題と技術的限界

AIモデルが複雑化し、扱うデータ量が増加するにつれて、AIアライメントを維持することが難しくなります。現在の技術では、AIの挙動を完全に制御し、予期せぬ事態を防ぐことが困難な場合があります。

特に、深層学習モデルは、その内部構造が複雑であるため、AIがどのように判断を下しているかを理解することが難しいという問題があります。そのため、AIが倫理的な問題を引き起こす可能性のある行動をとった場合でも、その原因を特定し、修正することが困難です。また、AIモデルが扱うデータ量が増加するにつれて、AIアライメントを維持するための計算コストも増加します。現在の技術では、大規模なAIモデルに対して、リアルタイムでAIアライメントを検証し、修正することが困難な場合があります。AIアライメントの研究者は、これらの課題を解決するために、AIの内部動作を理解しやすくするための技術や、AIアライメントを効率的に検証・修正するための技術を開発する必要があります。

AIアライメントを実現する方法

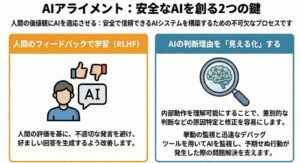

人間からのフィードバックを活用した学習(RLHF)

人間からのフィードバック強化学習(RLHF)は、AIモデルが人間の好みに合うように学習する方法です。AIの出力に対して人間が評価を行い、その評価を基にAIモデルを改善していきます。

RLHFは、AIモデルが人間の価値観や意図を理解し、それに沿った行動をとるようにするための有効な手段です。例えば、AIチャットボットが不適切な発言をした場合、人間からのフィードバックに基づいて、そのような発言を避けるように学習させることができます。また、AIが生成するテキストの品質を向上させるために、人間からのフィードバックを活用することもできます。RLHFは、AIアライメントを実現するための重要な技術の一つであり、その研究と実践は、より安全で信頼できるAIシステムの構築に不可欠です。RLHFを効果的に活用するためには、質の高いフィードバックデータを収集し、AIモデルがそのデータを適切に学習できるようにする必要があります。

AI解釈可能性の向上とデバッグ技術

AIの内部動作を理解しやすくすることで、問題の原因を特定し、修正することが容易になります。AI解釈可能性を高めるための技術や、AIの挙動を監視・デバッグするためのツールが開発されています。

AI解釈可能性とは、AIモデルがどのように判断を下しているかを人間が理解できる度合いを指します。AI解釈可能性を高めることで、AIが倫理的な問題を引き起こす可能性のある行動をとった場合でも、その原因を特定し、修正することが容易になります。例えば、AIが特定のグループに対して差別的な判断を下した場合、AI解釈可能性を高めることで、その原因となった要素を特定し、AIモデルを修正することができます。また、AIの挙動を監視・デバッグするためのツールは、AIが予期せぬ行動をとった場合に、その原因を特定し、修正するために役立ちます。AI解釈可能性の向上とデバッグ技術の開発は、AIアライメントを実現するための重要な取り組みであり、その研究と実践は、より安全で信頼できるAIシステムの構築に不可欠です。

AIアライメントの未来

AIガバナンスと規制の重要性

AI技術の発展に伴い、AIガバナンスと規制の重要性が増しています。AIアライメントに関する倫理的なガイドラインや法規制を整備することで、AIの悪用を防ぎ、安全なAI開発を促進することができます。

AIガバナンスとは、AI技術の開発・利用に関する倫理的な原則やルールを策定し、それを遵守するための仕組みを構築することを指します。AIガバナンスを確立することで、AIが社会に与える影響を適切に管理し、AIの悪用を防ぐことができます。また、AIに関する法規制を整備することで、AI技術の開発者や利用者が法的責任を負うことを明確にし、AIの安全な開発を促進することができます。AIガバナンスと規制は、AIアライメントを実現するための重要な要素であり、その整備は、AI技術が社会に貢献し、人類の福祉に寄与するための基盤を築く上で不可欠です。国際的な協力体制を構築し、AIガバナンスと規制に関する共通の基準を策定することも重要です。

AIとの共存に向けた展望

AIアライメントは、AIと人間が協調し、共存するための基盤となります。AIが人間の価値観を理解し、尊重することで、より良い未来を築くことができるでしょう。

AIが人間のパートナーとして、様々なタスクを支援し、人間の能力を拡張することで、より効率的で創造的な社会を実現することができます。例えば、AIが医療診断を支援することで、医師の負担を軽減し、より正確な診断を可能にすることができます。また、AIが教育を個別化することで、生徒一人ひとりのニーズに合わせた学習を提供し、教育の質を向上させることができます。AIアライメントは、AIと人間が互いに協力し、補完し合うことで、より豊かな社会を実現するための重要な要素であり、その研究と実践は、より良い未来を築くために不可欠です。AI技術の開発者は、AIアライメントを常に念頭に置き、人間との協調を重視したAIシステムを開発する必要があります。

まとめ

AIアライメントの重要ポイント

AIアライメントは、AI技術の発展と社会への浸透において不可欠な要素です。AIの倫理的な利用を促進し、リスクを軽減するために、研究者、開発者、政策立案者、そして一般の人々が協力して取り組む必要があります。

AIアライメントは、AI技術が社会に貢献し、人類の福祉に寄与するための基盤を築く上で重要な役割を果たします。AIアライメントに関する研究を推進し、AI技術の開発者が倫理的なガイドラインを遵守するように促し、AIに関する法規制を整備することで、より安全で信頼できるAIシステムの構築を促進することができます。また、AIアライメントに関する知識を一般の人々に普及させることで、AIに対する理解を深め、AI技術の恩恵を最大限に享受できるようにする必要があります。AIアライメントは、AI技術の発展と社会の発展が両立するための鍵となる要素であり、その重要性は今後ますます高まるでしょう。