AI技術の急速な発展に伴い、AIコンプライアンスの重要性が高まっています。本ガイドでは、企業がAI導入時に直面するリスクと対策、法規制、そして具体的な運用事例までを網羅的に解説します。AIコンプライアンスを理解し、安全かつ倫理的なAI活用を実現しましょう。

目次

ToggleAIコンプライアンスとは?基本と重要性

コンプライアンスの定義とAIへの適用

コンプライアンスとは、法令、企業倫理、社会規範を遵守することです。AIコンプライアンスは、これらの原則をAI技術の設計、開発、運用に適用し、潜在的なリスクを最小限に抑えるための取り組みを指します。これは、AIが社会に浸透するにつれて、ますます重要になっています。

AIコンプライアンスは、単に法律を守るだけでなく、倫理的な観点からもAIを適切に利用することを意味します。例えば、プライバシー保護、公平性、透明性などが重要な要素となります。企業は、AIコンプライアンスを確保することで、社会からの信頼を得ることができ、持続可能な成長につながります。

AI技術の急速な発展に伴い、コンプライアンスの範囲も変化しています。企業は、常に最新の情報を収集し、AIコンプライアンスの基準を更新する必要があります。また、従業員への教育や研修を通じて、AIコンプライアンスの意識を高めることも重要です。AIの利用が拡大する現代において、AIコンプライアンスは企業にとって不可欠な要素となっています。

なぜAIコンプライアンスが重要なのか?

AIコンプライアンスは、AIの潜在的なリスク、例えば偏ったアルゴリズムやプライバシー侵害などを回避するために不可欠です。また、企業の信頼性を高め、法的責任を果たす上でも非常に重要です。AI技術の利用が拡大するにつれて、その重要性はますます高まっています。

AIシステムは、大量のデータを学習することで、予測や判断を行います。しかし、学習データに偏りがある場合、AIは差別的な結果を生み出す可能性があります。AIコンプライアンスは、このような偏りを是正し、公平なAIを実現するための対策を講じることを求めます。

さらに、AIコンプライアンスは、企業が法的責任を果たすためにも重要です。個人情報保護法などの法律を遵守し、プライバシーを侵害しないようにAIを設計する必要があります。違反した場合、法的制裁を受けるだけでなく、企業の評判を大きく損なう可能性があります。したがって、AIコンプライアンスは、企業のリスク管理の一環として捉えるべきです。

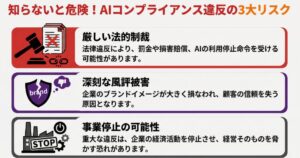

AIコンプライアンス違反のリスク

AIコンプライアンスに違反した場合、法的制裁、風評被害、事業停止などの重大なリスクが生じる可能性があります。適切なコンプライアンス体制の構築は、企業価値を守る上で不可欠です。特に、近年ではAIに関する規制が強化されており、違反した場合の罰則も厳しくなる傾向にあります。

法的制裁としては、罰金や損害賠償請求などが考えられます。また、AIの利用停止命令が出されることもあります。風評被害は、企業のブランドイメージを大きく損ない、顧客離れを引き起こす可能性があります。事業停止は、企業の経済的な損失だけでなく、従業員の雇用にも影響を与えます。

これらのリスクを回避するためには、AIコンプライアンスに関する専門知識を持つ人材を育成し、全社的なコンプライアンス体制を構築する必要があります。また、AIシステムの開発段階からコンプライアンスを考慮し、定期的な監査を実施することが重要です。AIコンプライアンスは、企業経営における重要な課題として認識されるべきです。

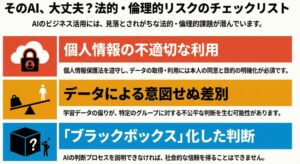

AI導入における法的・倫理的課題

個人情報保護法とAI

個人情報保護法は、AIが個人データを扱う際の重要な法的基準です。データの取得、利用、保管に関して厳格なルールを遵守する必要があります。AIは、個人を特定できる情報だけでなく、行動履歴や購買履歴などの情報も収集・分析することができます。これらの情報を適切に管理し、プライバシーを保護することが重要です。

個人情報保護法では、個人情報の取得に際して、利用目的を明示し、本人の同意を得る必要があります。また、取得した個人情報は、利用目的の範囲内で利用し、適切に管理しなければなりません。AIシステムを開発・運用する際には、これらのルールを遵守する必要があります。

さらに、個人情報保護法は、個人情報の第三者提供についても規制しています。AIが分析した結果を第三者に提供する場合には、本人の同意を得るか、匿名化処理を行う必要があります。AI技術の利用が拡大するにつれて、個人情報保護の重要性はますます高まっています。企業は、個人情報保護法を遵守し、プライバシーを尊重したAIシステムを開発・運用する必要があります。

差別禁止とAIの公平性

AIアルゴリズムが意図せず差別的な結果を生み出す可能性があります。公平性を確保するための対策(データの偏り是正、アルゴリズムの透明性確保など)が重要です。AIは、学習データに基づいて予測や判断を行うため、学習データに偏りがある場合、特定のグループに対して不利な結果を生み出す可能性があります。

例えば、採用選考AIが、過去の採用実績に基づいて学習した場合、特定の性別や人種に対して差別的な判断を下す可能性があります。このような差別を防止するためには、学習データの偏りを是正し、AIの公平性を確保する必要があります。

また、AIの意思決定プロセスを透明化することも重要です。AIがどのような根拠に基づいて判断を下したのかを明確にすることで、差別的な結果が生じた場合に、その原因を特定し、改善することができます。AIの公平性は、社会的な公正さを実現するために不可欠な要素です。企業は、AIの公平性を確保するために、積極的に取り組む必要があります。

AIの説明責任と透明性

AIの意思決定プロセスを明確にし、説明責任を果たす必要があります。モデルの透明性を高め、監査可能性を確保することが重要です。AIは、複雑なアルゴリズムに基づいて判断を行うため、その意思決定プロセスがブラックボックス化しやすいという問題があります。しかし、AIの利用が拡大するにつれて、その意思決定プロセスに対する説明責任が求められるようになっています。

例えば、AIがローンの審査を行った場合、なぜその申請が却下されたのかを説明する必要があります。また、AIが医療診断を行った場合、その根拠を医師や患者に説明する必要があります。AIの説明責任を果たすためには、モデルの透明性を高め、監査可能性を確保することが重要です。

モデルの透明性を高めるためには、AIの内部構造を理解しやすくする必要があります。また、監査可能性を確保するためには、AIの意思決定プロセスを記録し、必要に応じて検証できるようにする必要があります。AIの説明責任と透明性は、AIに対する信頼性を高めるために不可欠な要素です。企業は、AIの説明責任と透明性を確保するために、積極的に取り組む必要があります。

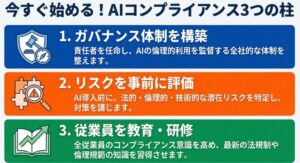

企業が取り組むべきAIコンプライアンス対策

AIガバナンス体制の構築

AIコンプライアンスを統括する責任者を任命し、全社的なガバナンス体制を構築します。明確な役割と責任を定めることが重要です。AIガバナンス体制は、AIの倫理的な利用を監督し、リスクを管理するために不可欠です。責任者は、AIコンプライアンスに関する最新の情報を収集し、社内の関係者に共有する役割を担います。

ガバナンス体制の構築には、AI倫理委員会のような組織を設立することも含まれます。この委員会は、AIプロジェクトの倫理的な側面を評価し、必要な場合には修正を勧告します。また、AIガバナンス体制は、AIに関する社内規定を策定し、従業員がこれを遵守するように指導する責任も負います。

さらに、AIガバナンス体制は、AIのリスクアセスメントを定期的に実施し、潜在的なリスクを特定し、対応策を講じる必要があります。AIガバナンス体制は、企業の規模やAIの利用状況に応じて、柔軟に構築する必要があります。AIガバナンス体制は、AIの倫理的な利用を促進し、リスクを管理するための重要な枠組みです。

リスクアセスメントの実施

AI導入前に潜在的なリスクを特定し、評価するためのリスクアセスメントを実施します。リスクの種類(法的、倫理的、技術的)に応じて適切な対策を講じます。リスクアセスメントは、AIプロジェクトの初期段階で実施することが重要です。法的リスクとしては、個人情報保護法違反や差別禁止法違反などが考えられます。

倫理的リスクとしては、プライバシー侵害や公平性の欠如などが考えられます。技術的リスクとしては、AIの誤動作やセキュリティ上の脆弱性などが考えられます。リスクアセスメントでは、これらのリスクを網羅的に洗い出し、それぞれのリスクの発生確率と影響度を評価します。

リスク評価の結果に基づいて、リスクを軽減するための対策を講じます。例えば、個人情報保護のためには、データの匿名化や暗号化などの技術を導入します。公平性を確保するためには、学習データの偏りを是正し、AIの意思決定プロセスを透明化します。技術的なリスクを軽減するためには、AIシステムのセキュリティ対策を強化し、定期的なテストを実施します。リスクアセスメントは、AIプロジェクトの成功に不可欠な要素です。

従業員への教育と研修

AIコンプライアンスに関する従業員の意識を高めるための教育・研修を実施します。最新の法規制や倫理規範に関する知識を習得させることが重要です。教育・研修は、全従業員を対象に行うことが望ましいですが、特にAIシステムの開発・運用に関わる従業員には、より専門的な知識を習得させる必要があります。

教育・研修の内容としては、AIコンプライアンスの基本原則、個人情報保護法、差別禁止法、AI倫理規範などが挙げられます。また、AIのリスクアセスメントやリスク軽減策に関する知識も重要です。教育・研修の方法としては、オンラインコース、集合研修、ワークショップなどがあります。

教育・研修の効果を高めるためには、事例研究やグループディスカッションなどを取り入れることが有効です。また、教育・研修後には、理解度を確認するためのテストを実施することも推奨されます。従業員への教育と研修は、AIコンプライアンスを徹底するための重要な取り組みです。企業は、継続的に教育・研修を実施し、従業員の意識を高める必要があります。

AIコンプライアンスを支援するツールとテクノロジー

コンプライアンステックの活用

リーガルテックやコンプライアンステックを活用することで、効率的かつ効果的なコンプライアンスチェックを実現できます。FRONTEOなどのツールも参考になります。コンプライアンステックは、AIコンプライアンスの様々な側面を支援することができます。例えば、AIのリスクアセスメントを自動化したり、AIの意思決定プロセスを監視したりすることができます。

また、コンプライアンステックは、個人情報保護法などの法規制への準拠を支援することもできます。コンプライアンステックを活用することで、企業はAIコンプライアンスのコストを削減し、効率を高めることができます。FRONTEOは、AIを活用したリーガルテックソリューションを提供しており、企業のコンプライアンス活動を支援しています。

FRONTEOのソリューションは、電子証拠開示、不正調査、リスク管理など、幅広い分野で活用されています。コンプライアンステックは、AIコンプライアンスを支援するための強力なツールです。企業は、自社のニーズに合ったコンプライアンステックを導入し、AIコンプライアンスを強化する必要があります。

AIモニタリングシステムの導入

AIの運用状況を継続的にモニタリングし、異常を検知するシステムを導入します。早期発見と対応により、リスクを最小限に抑えます。AIモニタリングシステムは、AIの性能低下やバイアスの発生などを検知することができます。また、AIの利用状況を把握し、不正利用を防止することもできます。

AIモニタリングシステムは、AIの出力結果、入力データ、内部状態などを監視します。異常が検知された場合には、アラートを発出し、担当者に通知します。担当者は、アラートの内容を確認し、適切な対応を行います。AIモニタリングシステムは、AIの信頼性を維持するために不可欠な要素です。

AIモニタリングシステムを導入する際には、監視対象となるAIの特性、リスクの種類、監視の頻度などを考慮する必要があります。また、AIモニタリングシステムは、プライバシー保護にも配慮する必要があります。AIモニタリングシステムは、AIの安全かつ倫理的な利用を促進するための重要なツールです。

データ分析ツールの活用

データの偏りや不整合を検出し、AIの公平性を確保するためのデータ分析ツールを活用します。バイアスを排除し、公正なAIを実現します。データ分析ツールは、AIの学習データに含まれる偏りを可視化し、是正するための機能を提供します。また、データ分析ツールは、AIの出力結果を分析し、差別的な結果が生じていないかを評価することもできます。

データ分析ツールを活用することで、AI開発者は、AIの公平性を意識したデータ収集・加工を行うことができます。また、AI運用者は、AIの出力結果を定期的に分析し、差別的な結果が生じていないかを確認することができます。データ分析ツールは、AIの公平性を確保するための重要なツールです。

データ分析ツールを選択する際には、データの種類、分析の目的、使いやすさなどを考慮する必要があります。また、データ分析ツールは、プライバシー保護にも配慮する必要があります。データ分析ツールは、AIの公平性を実現し、社会的な信頼を得るために不可欠な要素です。

AIコンプライアンスの未来と展望

AI規制の最新動向

EUAIActや各国の規制動向を把握し、最新の法規制に対応する必要があります。常にアンテナを張り、変化に柔軟に対応することが重要です。AI規制は、AIの倫理的な利用を促進し、リスクを管理するために不可欠です。EUAIActは、AIのリスクレベルに応じて規制を設けることを目指しています。

高リスクAIは、厳格な規制を受け、事前に適合性評価を受ける必要があります。低リスクAIは、透明性に関する義務が課されます。EUAIActは、AIの倫理的な利用を促進するための重要な一歩です。各国も、AIに関する規制を検討しています。例えば、米国では、AIの責任ある利用を促進するためのフレームワークが策定されています。

日本でも、AI戦略会議がAIに関する倫理指針を策定しています。AI規制は、技術の進歩とともに変化していく可能性があります。企業は、常に最新の情報を収集し、AI規制の変化に柔軟に対応する必要があります。AI規制への対応は、AIコンプライアンスの重要な要素です。

AI倫理フレームワークの進化

AI倫理に関する議論は進化し続けています。最新の倫理フレームワークを参考に、企業独自の倫理基準を策定し、実践することが重要です。AI倫理フレームワークは、AIの倫理的な利用を促進するための指針を提供します。AI倫理フレームワークは、透明性、公平性、説明責任、プライバシー保護などの原則を重視しています。

AI倫理フレームワークは、政府機関、学術機関、企業などによって策定されています。企業は、これらのフレームワークを参考に、自社のビジネスモデルや価値観に合った倫理基準を策定する必要があります。企業独自の倫理基準を策定する際には、従業員の意見を反映させることが重要です。

倫理基準は、AIプロジェクトの初期段階から適用し、定期的に見直す必要があります。AI倫理フレームワークは、AIの倫理的な利用を促進するための重要なツールです。企業は、倫理フレームワークを積極的に活用し、社会的な責任を果たす必要があります。

AIコンプライアンスの経営戦略への組み込み

コンプライアンスをコストではなく、競争優位性の源泉として捉え、経営戦略に組み込むことが重要です。持続可能なAI活用を実現し、企業価値を向上させましょう。AIコンプライアンスは、企業の信頼性を高め、ブランドイメージを向上させる効果があります。また、AIコンプライアンスを徹底することで、法的リスクを軽減し、事業継続性を確保することができます。

AIコンプライアンスを経営戦略に組み込むためには、経営層がAIコンプライアンスの重要性を認識し、積極的に取り組む必要があります。また、AIコンプライアンスに関する専門知識を持つ人材を育成し、全社的なコンプライアンス体制を構築する必要があります。

AIコンプライアンスを経営戦略に組み込むことで、企業は持続可能なAI活用を実現し、社会からの信頼を得ることができます。AIコンプライアンスは、企業の長期的な成長に不可欠な要素です。