AI技術の進化と共に、巧妙化するディープフェイク。本記事では、ディープフェイクの脅威から身を守るための最新対策を、企業と個人向けにわかりやすく解説します。事例、検知技術、法的側面、そして未来への展望まで、幅広くカバーします。

目次

Toggle最新ディープフェイク対策:企業と個人のための包括的ガイド

ディープフェイクとは?基本と進化

ディープフェイクの定義と仕組み

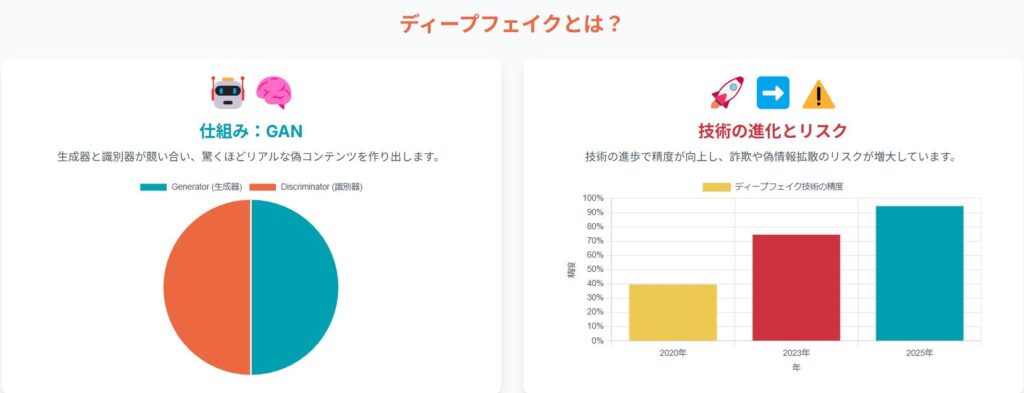

ディープフェイクは、AI技術を悪用し、既存の画像や動画を加工・合成して、現実には存在しない映像を作り出す技術です。特にディープラーニングという手法が用いられ、驚くほどリアルなフェイクコンテンツが生成されます。ディープフェイクは、高度な画像処理と音声合成技術を組み合わせることで、あたかも本物のような錯覚を生み出します。この技術の根幹には、敵対的生成ネットワーク(GAN)と呼ばれる機械学習モデルが存在し、二つのネットワークが互いに競い合いながら、よりリアルなフェイク画像を生成していくのです。この仕組みを理解することで、ディープフェイクがどのように作られているのか、その本質を捉えることができます。GANは、生成器(Generator)と識別器(Discriminator)という二つのニューラルネットワークで構成されています。生成器は、ランダムなノイズから画像を生成し、識別器は、生成された画像が本物か偽物かを判断します。このプロセスを繰り返すことで、生成器はよりリアルな画像を生成できるようになり、識別器もより正確に偽物を見抜けるようになります。

ディープフェイク技術の歴史と進化

初期のディープフェイクは粗雑なものでしたが、AI技術の進歩とともに、その精度は飛躍的に向上しています。現在では、専門家でも見破ることが難しいレベルのディープフェイクも存在します。黎明期には、顔交換アプリなどが登場し、エンターテイメントとして楽しまれていましたが、技術の進化に伴い、政治的なプロパガンダや詐欺など、悪意のある目的で使用されるケースが増加しています。特に、SNSの普及により、拡散スピードが加速し、社会に与える影響も大きくなっています。技術の進化は止まることがなく、より高度なディープフェイクが生成される可能性があり、対策もまた進化を続ける必要があります。ディープフェイク技術の初期の段階では、単純な顔の入れ替えや、口の動きの修正などが主なものでした。しかし、近年では、AI技術の発展により、顔全体の表情や、体の動き、さらには声色まで、より自然に再現できるようになっています。例えば、映画の特殊効果では、俳優の顔を若返らせたり、亡くなった俳優をCGで蘇らせたりする技術が利用されています。また、音声合成技術の進歩により、故人の声を再現し、新たなメッセージを語らせることも可能になっています。

ディープフェイクの潜在的な活用例

エンターテイメント業界では、故人の映像を再現したり、AIアナウンサーを制作するなど、革新的な活用例が生まれています。SHIFTなどの企業は、セキュリティ分野での活用も模索しています。例えば、映画制作においては、過去の俳優をCGで蘇らせ、新たな作品に出演させることが可能になります。また、教育分野では、歴史上の人物が講義を行うような、インタラクティブな学習コンテンツの制作も考えられます。セキュリティ分野においては、ディープフェイク技術を悪用した攻撃を検知するための防御システムの開発が進められています。ただし、これらの活用例は、倫理的な問題を伴う可能性もあり、慎重な検討が必要です。医療分野では、患者の表情や声の変化を分析し、病気の早期発見に役立てる研究も進められています。また、顧客対応の分野では、AIアバターが顧客の質問に答えたり、相談に乗ったりするサービスも登場しています。しかし、これらの活用例は、個人情報の取り扱いや、プライバシーの問題など、様々な倫理的な問題を伴う可能性があります。

ディープフェイクによるリスクと対策

企業が直面するリスク:なりすましと情報漏洩

ディープフェイクによる従業員のなりすましや、企業の機密情報を詐取するリスクが高まっています。これに対し、多要素認証や厳格なアクセス管理が不可欠です。具体的には、顔認証に加えて、指紋認証や虹彩認証などの生体認証を組み合わせることで、なりすましのリスクを大幅に軽減できます。従業員へのセキュリティ教育も重要であり、不審なメールやメッセージに対する警戒心を高める必要があります。また、情報漏洩対策として、データの暗号化やアクセスログの監視を徹底することも重要です。定期的なセキュリティ監査を実施し、脆弱性を早期に発見し、対策を講じる必要があります。近年では、ディープフェイクを用いて企業の幹部になりすまし、重要な会議に参加したり、機密情報を聞き出したりする事例も報告されています。また、従業員のSNSアカウントを乗っ取り、企業の評判を貶めるような情報を拡散するケースも存在します。これらのリスクを防ぐためには、従業員一人ひとりがセキュリティ意識を高め、不審な点に気づいたらすぐに報告する体制を構築することが重要です。

個人を狙う脅威:詐欺とプライバシー侵害

個人情報を使った詐欺や、プライバシーを侵害するディープフェイク動画の拡散は、深刻な問題です。警戒心を持ち、安易に個人情報を公開しないことが重要です。SNSなどのオンラインプラットフォームでは、個人情報の公開範囲を制限し、プライバシー設定を強化することが重要です。また、不審なメールやメッセージには注意し、安易にリンクをクリックしたり、個人情報を入力したりしないようにしましょう。ディープフェイク動画が拡散された場合は、プラットフォーム運営者に削除を依頼するなどの対応が必要です。弁護士などの専門家に相談することも検討しましょう。著名人の顔や声を悪用した詐欺広告や、一般人の顔をアダルトコンテンツに合成した動画などが拡散される事例が後を絶ちません。これらの被害に遭わないためには、オンライン上での情報発信には十分注意し、不審なサイトやアプリには近づかないことが重要です。また、家族や友人と協力し、互いに注意喚起し合うことも有効です。万が一、被害に遭ってしまった場合は、警察や消費者センターに相談し、適切なアドバイスを受けるようにしましょう。

偽情報拡散:社会への影響

政治的なデマや誤情報の拡散は、社会を混乱させる可能性があります。情報の真偽を見極める能力、すなわち情報リテラシーを高めることが重要です。情報の出所を確認し、複数の情報源を比較検討することで、情報の信頼性を判断することができます。また、感情的な反応を避け、客観的な視点を持つことも重要です。メディアリテラシー教育を推進し、子供の頃から情報の正しい扱い方を学ぶことが重要です。ファクトチェック機関などの信頼できる情報源を活用し、偽情報に惑わされないようにしましょう。近年では、ディープフェイクを用いて政治家の不適切な発言を捏造したり、事件の現場を再現した偽の動画を拡散したりする事例が発生しています。これらの偽情報は、選挙の結果を左右したり、社会不安を煽ったりする可能性があります。情報リテラシー教育を強化し、市民一人ひとりが情報の真偽を見極める能力を高めることが重要です。また、SNSプラットフォームは、偽情報対策を強化し、拡散を防止するための措置を講じる必要があります。

ディープフェイク検知技術と対策ツール

最新のディープフェイク検知技術

AIを活用した画像解析や、動画の不自然な動きを検出する技術が開発されています。しかし、ディープフェイク技術も進化するため、検知技術も常にアップデートが必要です。具体的には、顔の歪みや目の瞬きの不自然さ、音声の不自然な変化などを検知する技術が開発されています。また、ディープラーニングモデルを用いて、ディープフェイク画像を学習し、本物と偽物を見分ける技術も存在します。しかし、これらの検知技術は完璧ではなく、高度なディープフェイクには対応できない場合があります。そのため、複数の検知技術を組み合わせたり、人間の目による確認も重要です。ディープフェイク検知技術は、大きく分けて、画像解析、音声解析、メタデータ解析の3つの分野に分類されます。画像解析では、顔の歪みや目の瞬きの不自然さ、肌の質感などを分析し、ディープフェイクの痕跡を見つけ出します。音声解析では、音声のトーンやリズム、ノイズなどを分析し、音声合成や加工の痕跡を見つけ出します。メタデータ解析では、ファイルの作成日時や場所、編集履歴などを分析し、コンテンツの信頼性を検証します。

C2PA:コンテンツ認証の新たな標準

コンテンツの来歴を記録するC2PAのような技術は、ディープフェイク対策の鍵となります。コンテンツの出所を明確にすることで、偽情報のリスクを低減できます。C2PAは、ContentAuthenticityInitiative(CAI)が提唱する技術仕様で、画像や動画などのデジタルコンテンツの作成者や編集履歴などの情報を記録することができます。これにより、コンテンツの信頼性を検証することが可能になり、ディープフェイクなどの偽情報対策に役立ちます。C2PAに対応したツールやプラットフォームの普及が期待されます。コンテンツの作成者は、C2PAを活用してコンテンツの信頼性を担保し、利用者はC2PAの情報に基づいてコンテンツの真偽を判断することが重要です。C2PAは、コンテンツの作成者、編集者、配信者などが、コンテンツの来歴情報を付与することを可能にします。この情報には、作成者のID、作成日時、編集履歴、使用されたソフトウェアなどが含まれます。C2PAに対応したプラットフォームでは、これらの情報を表示することで、ユーザーはコンテンツの信頼性を確認することができます。C2PAは、ディープフェイク対策だけでなく、著作権侵害やなりすましなどの問題解決にも役立つと期待されています。

企業向け対策ツールの導入と活用

Fujisoftなどが提供するディープフェイク検知ツールを導入し、定期的なスキャンを行うことで、リスクを早期に発見し対応できます。これらのツールは、AI技術を活用して、画像や動画の不自然な点を検出し、ディープフェイクの可能性を指摘します。企業は、これらのツールを導入することで、自社のブランドイメージや従業員の個人情報を守ることができます。また、従業員への教育も重要であり、ディープフェイクのリスクや対策について理解を深める必要があります。定期的なセキュリティ監査を実施し、対策の有効性を検証することも重要です。ディープフェイク検知ツールは、画像や動画だけでなく、音声データの分析にも対応しているものがあります。これらのツールは、音声のトーンやリズム、ノイズなどを分析し、音声合成や加工の痕跡を見つけ出します。企業は、これらのツールを活用して、顧客対応の音声データや、社内会議の録音データなどを分析し、情報漏洩のリスクを早期に発見することができます。また、従業員向けのトレーニングプログラムを導入し、ディープフェイクのリスクや対策について理解を深めることも重要です。

法的規制と倫理的課題

日本における法規制の現状

現時点では、ディープフェイクに特化した法規制は存在しません。しかし、名誉毀損や著作権侵害などの既存の法律で対応できる場合があります。例えば、ディープフェイク動画によって名誉を傷つけられた場合は、名誉毀損罪で訴えることができます。また、著作権を侵害するディープフェイク動画を制作・公開した場合は、著作権法違反で訴えることができます。ただし、これらの法律は、ディープフェイク特有の問題に対応するには限界があります。そのため、ディープフェイクに関する法規制の整備が求められています。例えば、ディープフェイクを用いて他人のプライバシーを侵害した場合や、詐欺行為を行った場合の法的責任を明確にする必要があります。また、ディープフェイクの制作・公開に関する規制や、ディープフェイクの被害者に対する救済措置なども検討する必要があります。法規制の整備と同時に、技術開発や国際的な連携も重要です。

国際的な法規制の動向

EUなどでは、AI規制の一環としてディープフェイクに関する法規制が進んでいます。国際的な動向を注視し、適切な対応を検討する必要があります。EUでは、AI法案において、ディープフェイクなどの生成AIに関する規制が盛り込まれており、透明性の確保やリスク管理が義務付けられる予定です。米国では、ディープフェイクによる選挙妨害などを防止するための法案が検討されています。これらの国際的な動向を踏まえ、日本においても、ディープフェイクに関する法規制の整備を検討する必要があります。EUのAI法案では、ディープフェイクなどの生成AIによって作成されたコンテンツには、その旨を明示することが義務付けられています。また、ディープフェイクのリスクが高いと判断された場合は、より厳格な規制が適用される可能性があります。米国では、ディープフェイクによる選挙妨害を防止するために、ディープフェイクを用いた政治広告の規制や、ディープフェイクの作成者情報の開示義務などが検討されています。

ディープフェイク利用における倫理的課題

ディープフェイク技術の利用は、表現の自由とプライバシー保護のバランスが重要です。倫理的なガイドラインを設け、責任ある利用を心がける必要があります。例えば、ディープフェイク動画を制作する場合は、対象者の同意を得ることが重要です。また、政治的なプロパガンダや詐欺などの悪意のある目的でディープフェイクを利用することは避けるべきです。ディープフェイク技術の利用者は、倫理的な責任を自覚し、社会に悪影響を与えないように配慮する必要があります。倫理的なガイドラインを策定し、技術者や利用者の教育を推進することが重要です。ディープフェイク技術は、エンターテイメントや教育など、様々な分野で活用できる可能性を秘めていますが、同時に、悪用されるリスクも存在します。そのため、技術者は、倫理的な観点から、技術の開発や利用方法を検討する必要があります。また、利用者は、ディープフェイク技術の潜在的なリスクを理解し、責任ある利用を心がける必要があります。

個人のためのディープフェイク対策

情報リテラシーの向上

ニュースやSNSで目にする情報が真実かどうかを常に疑う姿勢を持つことが重要です。情報の出所を確認し、複数の情報源を比較検討することで、情報の信頼性を判断することができます。また、感情的な反応を避け、客観的な視点を持つことも重要です。特に、SNSで拡散されている情報は、デマや誤情報である可能性が高いため、注意が必要です。情報の真偽を判断する際には、ファクトチェック機関などの信頼できる情報源を活用することが有効です。また、家族や友人と協力し、互いに情報交換をすることで、より客観的な判断をすることができます。

プライバシー設定の見直し

SNSなどのオンラインプラットフォームでは、個人情報の公開範囲を制限し、プライバシー設定を強化することが重要です。特に、顔写真や氏名、住所などの個人情報は、悪用されるリスクが高いため、公開範囲を慎重に検討する必要があります。また、位置情報サービスの設定も見直し、不要な場合はオフにすることをおすすめします。オンラインプラットフォームのプライバシー設定は、定期的に見直し、最新の状態に保つことが重要です。また、パスワードを強化し、定期的に変更することも、個人情報を保護するために重要です。

セキュリティソフトの導入

パソコンやスマートフォンにセキュリティソフトを導入し、マルウェアやウイルスから保護することが重要です。セキュリティソフトは、定期的にアップデートし、最新の状態に保つことが重要です。また、不審なメールやウェブサイトにはアクセスしないように注意しましょう。セキュリティソフトは、ディープフェイク対策に直接役立つわけではありませんが、個人情報を保護し、詐欺被害に遭わないために、重要な役割を果たします。また、OSやブラウザなどのソフトウェアも、常に最新の状態に保つことが、セキュリティ対策として重要です。

まとめ:ディープフェイク対策の重要性と今後の展望

ディープフェイク対策は、企業と個人にとって不可欠な課題です。技術の進化に合わせ、常に最新の情報に基づいた対策を講じることが重要です。C2PAなどの技術を活用し、安全なデジタル社会を目指しましょう。ディープフェイク技術は、今後も進化を続け、より高度で巧妙なものが登場する可能性があります。そのため、対策も常にアップデートしていく必要があります。企業は、セキュリティ対策を強化し、従業員の教育を徹底することで、リスクを軽減することができます。個人は、情報リテラシーを高め、偽情報に惑わされないように注意する必要があります。政府や関係機関は、法規制の整備や技術開発の支援を通じて、ディープフェイク対策を推進していく必要があります。今後は、ディープフェイク技術の悪用を防ぐために、技術的な対策だけでなく、法的な規制や倫理的なガイドラインの整備が不可欠です。また、国際的な連携を強化し、グローバルな視点での対策を講じる必要があります。